GPT (Generative Pre-training Transformer) è un modello di linguaggio sviluppato da OpenAI che è stato progettato per la generazione di testo basato sulla pre-formazione su grandi quantità di dati di testo. GPT è stato progettato per essere in grado di generare testo che risulta credibile e coerente in una varietà di contesti, ma come qualsiasi modello di linguaggio, ha alcuni limiti e non può sostituire completamente la capacità umana di comprensione e produzione del linguaggio.

Il sorprendente bot basato su intelligenza artificiale ChatGPT se la cava bene nelle conversazioni su molte tematiche, simulando un linguaggio piuttosto naturale, ma ha un punto debole peraltro comune a moltissime persone ovvero la matematica. Se posta davanti a quesiti che mettono insieme comprensione del testo, calcoli e logica può fornire risposte errate e anche se si è testato come possa correggersi se viene indirizzata adeguatamente all'interno della conversazione, in generale tende a muoversi in modo casuale e poco coerente.

Per funzionare pesca da un immenso database di campioni di testi catalogati da svariate fonti come libri, articoli di giornale oppure pagine web. Comprende anche l'italiano ed è accessibile gratuitamente previa registrazione dal sito ufficiale del progetto, per chi desidera intrattenersi anche con fatti inventati e divagazioni di vario tipo.

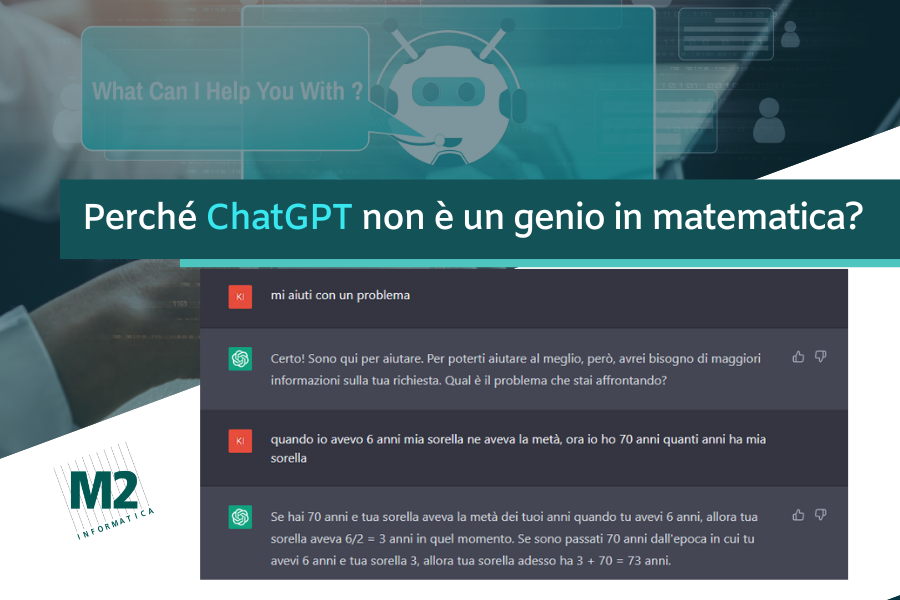

Tuttavia, la matematica per ChatGPT rimane un argomento ostico. Lo hanno segnalato nei giorni scorsi parecchi utenti lamentando che anche i problemi di algebra più elementari mettono in crisi il sistema, che risponde con la sua solita sicurezza sbagliando però clamorosamente i risultati. Anche noi abbiamo posto un semplice problema di logica (vedi foto ) a ChatGPT, che ha subito mostrato le sue lacune. Tuttavia, una volta spiegato l'errore all'intelligenza artificiale si è parzialmente ravveduta, anche se il risultato era nuovamente sbagliato.

Solo al secondo (doppio) aiutino il sistema è riuscito a dare la risposta corretta.

Aprendo una nuova chat e riproponendo il medesimo problema, ma con cifre diverse, ChatGPT riesce subito a trovare la risposta corretta, quasi come se avesse imparato dall'errore. Ma basta proporre la medesima domanda da un altro computer con un'altra utenza ed ecco che il risultato è di nuovo errato.

Ma perché ChatGPT ha queste lacune in matematica nonostante sia a tutti gli effetti un computer?

La risposta è semplice: le chatbot basate su intelligenza artificiale sono sviluppate per essere ottime conversatrici, tarate principalmente sull'offrire risposte fluenti nella lingua dell'interlocutore e pescando sì informazioni dalla banca dati di apprendimento, ma senza aver sviluppato vera “esperienza” in alcun settore.

L'avvertenza degli sviluppatori in fase di login lo dice chiaramente: il modello “può generare informazioni non corrette”, e questo vale soprattutto per argomenti che richiedono ragionamenti laterali, approcci creativi o un buon livello di astrazione come i problemi di matematica e logica.